L'IA de Google apprend à analyser le monde à travers l'appareil photo d'un smartphone

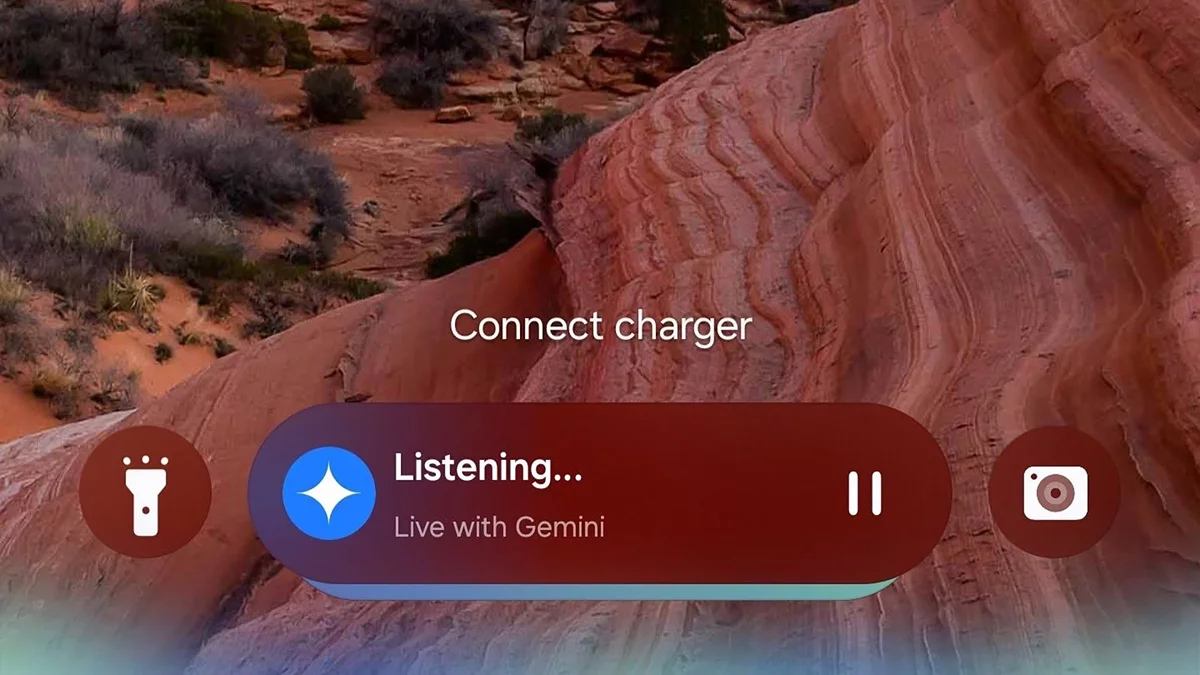

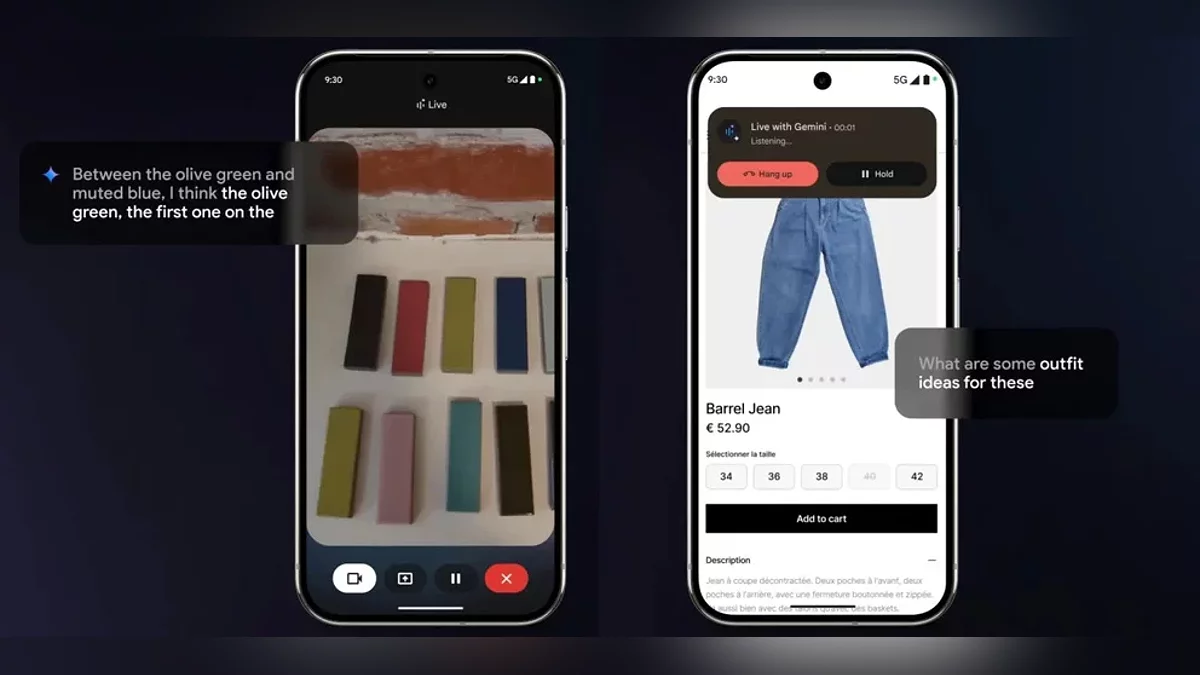

À MWC à Barcelone, Google a introduit de nouvelles fonctionnalités révolutionnaires pour son assistant IA, Gemini. À partir de mars, les abonnés au plan Google One AI Premium pourront transformer leurs smartphones en « yeux » alimentés par l'IA grâce à deux innovations clés : l'Analyse Vidéo en Direct et le Partage d'Écran Intelligent.

L'Analyse Vidéo en Direct permet à l'assistant de traiter instantanément les entrées de la caméra en temps réel. Les utilisateurs peuvent pointer leur caméra sur un vêtement pour obtenir des conseils de style ou scanner une pièce pour recevoir des suggestions de design d'intérieur. Gemini ne se contente pas de « voir » ce qui est à l'écran, il engage activement le dialogue. Par exemple, les utilisateurs peuvent lui demander d'optimiser un itinéraire de navigation ou de clarifier un graphique complexe dans une présentation, recevant des explications dans un format dynamique et conversationnel.

Pour l'instant, ces fonctionnalités ne sont disponibles que sur les appareils Android avec support multilingue. Au stand de Google, l'entreprise a présenté Gemini fonctionnant sur des appareils Samsung, Xiaomi et d'autres partenaires, soulignant la compatibilité entre marques. Aucune information n'a encore été donnée sur la date à laquelle les utilisateurs d'iOS auront accès.

Les mises à jour annoncées ne sont qu'un pas vers le projet ambitieux Astra de Google. D'ici 2025, l'entreprise vise à développer un assistant multimodal universel capable de :

- Analyser simultanément des données vidéo, audio et textuelles ;

- Maintenir le contexte de la conversation pendant jusqu'à 10 minutes ;

- Intégrer des données provenant de Search, Lens et Maps pour des solutions complètes.

Bien que Google n'ait pas officiellement annoncé Astra comme un produit autonome, les experts spéculent que ses fonctionnalités seront progressivement intégrées à Gemini, intensifiant la concurrence avec ChatGPT. Notamment, OpenAI a proposé un mode vocal élargi avec analyse d'écran depuis décembre 2023, mais Google parie sur une intégration profonde avec son propre écosystème.

La capacité de l'IA à traiter des informations visuelles en temps réel brouille la ligne entre les mondes numérique et physique. Les utilisateurs n'interagissent plus seulement avec un « assistant parlant », mais s'engagent avec un participant actif dans leurs tâches quotidiennes, allant des achats à l'apprentissage. Avec le lancement de Gemini Vision, les assistants IA entrent dans une ère d'interaction hyper-contextuelle, où la question clé passe de « Comment demander ? » à « Que montrer ? »

Une question majeure demeure : la vie privée. Comment Google protégera-t-il les données transmises par la caméra et l'écran ? L'entreprise assure que toutes les analyses sont effectuées selon des normes de sécurité strictes, mais les détails complets ne seront révélés qu'une fois les fonctionnalités officiellement lancées.

-

Protection Améliorée 2.0 : Google Chrome Introduit une Défense Alimentée par l'IA Contre les Menaces Inconnues

-

Google Play Protect détecte désormais les menaces en temps réel grâce à une mise à jour majeure de la sécurité

-

Google publie la première version bêta publique d'Android 16

-

Google Chrome passe en mode autopilote : le navigateur remplace désormais automatiquement les mots de passe compromis

-

Google a lancé une « guerre silencieuse » contre les bloqueurs de publicité : les outils de blocage de publicité populaires échouent